ChatGPT, le génie qui va nous remplacer?

Au départ, j’allais écrire un mini article avec une blague sur ChatGPT. Et puis les derniers “progrés” m’ont donné envie d’aller un peu plus loin.

Introduction

Qui n’a pas encore entendu parler de ChatGPT et ses petits copains concurrents? La promesse d’atteindre l’intelligence artificielle généralisée (AGI) dans moins de 5 ans est sur le tapis. Où comment un réseau neuronal doit tout savoir, tout comprendre et prendre de meilleures déçisions que les humains. (Oui, je sais, il suffit de lire le classement des “Darwin Award” pour être rapidement convaincu par les propos d’un Sam Altman …).

Un progrès quotidien mais…

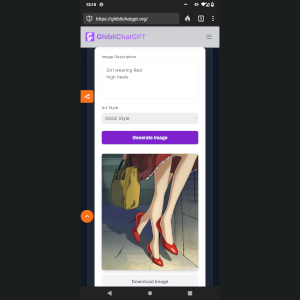

C’est vrai, les progrès de ces IA sont quotidiens mais sont aussi utiles qu’une saucisse pour pour écouter de la musique. Au moment de l’écriture de cet article, ChatGPT peut reproduire le style graphique de Ghibli (sans aucune autorisation) et se souvenir du contexte des trois dernières questions, mais pour quel usage?. Curieux, même si je ne suis pas fan de Ghibli, j’ai testé le nouveau rejeton d’OpenAI. L’image, obtenue à la première requête (“girl wearing red high heels”), se passe de commentaire.

L’autre fonctionnalité dont le résultat est montré partout est la transformation d’une photo en dessin Ghibli. Comme il faut s’identifier avec un compte Google, je n’ai pas d’exemple à montrer.

Le grand remplacement?

Même Billou (Bill Gates pour les pécores) s’y met: l’IA va nous remplacer dans tous les domaines, dans tous les sujets, faire tout mieux et plus vite [sur People.com[(https://people.com/bill-gates-ai-will-replace-doctors-teachers-in-next-10-years-11705615). Les “agents” autonomes capables d’interagir avec vos applications sont la prochaine révolution (et le prochain enfer de sécurité) et là, c’est sûr, on va tous perdre notre job. (En étant sarcastique, il n’y a pas de souci à se faire, les bénéfices tirés seront reversés équitablement entre tous via le revenu universel - autre concept testé par Sam Altman, mais qu’il ne met plus vraiment en avant -).

Par contre, l’horlogerie Suisse n’est pas menacée! En effet, un ChatGPT valorisé plus de 160 milliards de CHF ne sait pas donner l’heure!

Et les développeurs dans tout ça?

On trouve de plus en plus de tutoriels sur la meilleure façon de questionner ces “assistants” pour programmer mais je n’ai rien vu d’autre que des mini-jeux (snake, entre autre) non aboutis et

des applications de todo-list ou trucs du même acabit (tiens, un “emoji maker”). Autant dire qu’on ne va pas bien loin. Si vous trouvez étrange la pauvreté des exemples, c’est tout à fait normal:

ce sont les programmes parmi les plus simples, souvent écrits en React + Supabase. Et ce sont les mêmes programmes qui étaient utilisés dans des tutoriels sans assistant IA!

Et pourquoi on ne trouve rien de plus professionnel? Parce qu’une entreprise ne va pas publier son code source puisque son logiciel reflète une grand partie de son organisation opérationnelle.

On trouve également des partages d’expérience sur les apports de tels outils pour débugguer, mais encore une fois, sur des toutes petites parties de code. Corriger un vrai problème en production requière souvent de disposer de quatres éléments: le code source, la configuration, les données et les connaissances métier du processus. Et là, l’assistant IA peut bien se lever de bonne heure pour tout rassembler. Et sinon, au delà de 800 lignes, l’assistant a la flemme visiblement ( Article sur ArsTechnica ).

Et je passe rapidement et volontairement sur cette nouvelle tendance (on dirait une trend tiktok tellement c’est d’une idiotie crasse) de “vibe coding” qui consiste à tout simplement prendre la réponse de l’IA comme étant parole divine, sans se soucier de comprendre le code ni ses implications dans le cadre complexe de production. ( “Karpathy’s ‘Vibe Coding’ Movement Considered Harmful” sur NMN blog ). Et si la proposition ne fonctionne pas, il suffit de demmander à l’IA, encore et encore et encore. Autant dire que le code va être ultra-qualitif, pérenne et diablement sécurisé. Quelques mèmes pour illustrer le propos

Accessoirement, une IA n’est pas un moteur de recherche. Du fait que l’IA mélange et reformule les articles qu’elle a pillé, elle présente certes un résultat mais pas les résultats, ce qui propage l’idée qu’elle sait mieux, faussant ainsi la recherche et l’apprentissage: on n’a pas besoin d’essayer de comprende les articles qu’on lit puisqu’on a le sentiment que l’IA l’a déjà fait pour nous.

Conclusion

Plus on utilisera ces produits d’IA, plus on montrera comment s’en servir pour tout et n’importe et plus on fera le jeu des big tech en légitimant leurs projets. En parallèle de concept de “dé-googlisation d’internet”, n’ayons pas peur de ne pas utiliser ces produits car, en fin de compte, ils ne font que mal recopier ce que l’on a déjà écrit. (N’oublions pas que Stackoverflow et Github ont été pillés pour entraîner les modèles d’IA).

Et puis, c’est bien beau de tout donner à faire à ces produits [déso, j’arrive pas à écrire “programme”] mais pour quel plaisir? La voiture autonome va nous retirer le plaisir de conduire, les résumés automatiques vont nous faire perdre le plaisir de lire et d’une manière générale, on perdra le plaisir et la fierté du travail bien fait. Je ne pense pas qu’un paquet de neurones artificielles doit avoir le pouvoir de décider ce qui nous plait ou non. En fin de compte, on perd le contrôle des limites qu’on doit se fixer (tant du point de vue sociétal que personnel) et par extension on se dé-responsabilise de tout et tout le monde. C’est ainsi qu’on ouvre les portes d’une société totalitaire.